Seit den futuristischen Tonexperimenten zu Beginn des letzten Jahrhunderts werden Klangobjekte künstlich erzeugt oder bis zur Unkenntlichkeit verfremdet. Neben der ursprünglich dokumentarischen Funktion von Tonaufnahmen haben sich andere Formen entwickelt, von der abstrakten Geräuschkomposition bis hin zur fiktionalen Konstruktion intergalaktischer Klangwelten, von Träumen oder Halluzinationen.

Die Fiktion begibt sich jedoch auf brüchiges Terrain, wenn sie den vertrauten Horizont der Alltagserfahrung verlässt. Wenn ein Sounddesigner wie Mark Mangini tibetanischen Mönchsgesang zum Vorbeirauschen eines Raumschiffs transformiert oder Richard Beggs aus dem Geräusch von industriellen Metallscheren ein Atmen mit subtilem metallischem Touch bastelt, muss die Frage der Beziehung zwischen Original und Abbildung neu gestellt werden.

Klassische Positionen

Von Balázs über Metz bis Kittler haben Filmtheoretiker die These vertreten, dass der Filmton in der Kette seiner Aufnahme und Wiedergabe keiner Veränderung unterworfen sei. «Im Prinzip», so Metz, «gibt es keinen Unterschied zwischen einem Schuss, den man in einem Film hört, und einem Schuss auf der Strasse.»1 Balázs hat diesen Gedanken sogar noch konkreter formuliert: «Der Tonoperateur hat nicht die Möglichkeit, den gleichen Ton, seiner künstlerischen Persönlichkeit entsprechend, auf verschiedene Art darzustellen.»2 Noch 1989 taucht bei Kittler3 ein ähnlicher Gedanke auf, mit dem Ziel zu beweisen, dass Tonmeister nicht schöpferisch tätig sind, sondern höchstens im Rahmen eines weitgehend automatisierten Prozesses eine steuernde Funktion ausüben. Diese Auffassung ist immer noch weit verbreitet und von verheerender Konsequenz auch für die Praxis. Denn aus diesem Grund sind Sounddesigner von allen Urheberrechtsansprüchen bis heute ausgeschlossen.

Kunst wird in den zitierten klassischen Positionen als ein Filterungs- und Transformationsprozess verstanden. Auf der einen Seite stehen die Phänomene der physikalischen Welt, einer wie auch immer wahrgenommenen Wirklichkeit, auf der anderen Seite das Kunstprodukt, in das sich eine subjektive Weltsicht des schöpferischen Individuums einschreibt. Diese Theoretiker sprechen der Tonaufzeichnung einen künstlerischen Mehrwert ab, weil sie im Aufnahme- und Wiedergabeprozess keine geometrische Dimension verliert. Sie erheben somit die phänomenologische Betrachtung eines einzelnen physikalischen Aspekts zum alles entscheidenden Kriterium.

Selbstverständlich ist es nicht möglich, im Rahmen dieses Aufsatzes die ganzen abbildungstheoretischen Fragestellungen erschöpfend zu behandeln.4 Vielmehr werde ich einige Aspekte dieser Debatte auswählen und auf dem Hintergrund der gegenwärtigen Praxis diskutieren.

Nun hat sich in eben dieser Abbildungstheorie ein Katalog von Kriterien herausgebildet, die auch dem Alltagsverständnis zugänglich sind.

Kausalitätsbeziehung

Zunächst geht man davon aus, dass es eine Kausalitätsbeziehung gibt. Man nimmt als Zuschauer/Hörer an, dass am Anfang eine Originalszene stand – ein Objekt oder Ereignis – das als Sujet für die Abbildung dient, zum Beispiel der Schuss bei Metz. Die Aufnahme wäre dann die Spur einer vergangenen Wirklichkeit. Die Kausalitätsbeziehung ist jedoch nicht hinreichend, weil sie allein keine getreue Wiedergabe garantieren kann. Die Tonaufnahme eines Schusses kann bei Übersteuerung wie ein gigantisches Knattern klingen, bei Untersteuerung wäre hingegen nur ein leises «Plopp» zu hören.

Zweitens ist die Kausalitätsbeziehung nicht notwendig; dies gilt im Besonderen für neuere Technologien der virtuellen Bild oder Tonproduktion. Klangobjekte können am Synthesizer simuliert werden – zum Beispiel das Schlagen der Rotorblätter eines Hubschraubers oder das Sausen des Windes –, oder man kann sie auf einer drucksensitiven Monitorfläche zeichnerisch entwerfen.

Drittens wird in der Praxis des Sounddesigns die Kausalitätsbeziehung meist durch Substitution aufgelöst, wie das rhythmische Klappern von Kokosnussschalen als Ersatz für Pferdegetrappel.

Ein Beispiel aus Terminator 2: Judgment Day (James Cameron, USA 1991) soll diesen Substitutionsprozess beschreiben. Dort stellt sich die Frage, wie man einen Cyborg, ein hybrides Mensch-Maschinen-Wesen, in halbflüssigem Zustand klanglich charakterisieren kann. Wenn es darum geht, solche Drehbuchideen und optische Tricks mit einem Klangobjekt zu versehen, hat die Stunde der echten Audiophilen geschlagen: «Ich versuchte, Effekte von Flüssigkeiten auf eine besondere Art aufzunehmen. Deshalb spielte ich mit Hundefutter herum und liess es aus der Dose gleiten, was ein metallisch-flüssiges Geräusch erzeugt, das ich besonders mag. Man dreht die Dose um, sodass das Hundefutter mit einem saugenden Geräusch herausrutscht. [...] Ausserdem hielt ich einen Topf voll Schlamm, einer Mischung aus Mehl und Wasser, zwischen meinen Knien, tauchte ein Mikrofon hinein, das ich zuvor in ein Präservativ eingepackt hatte, und sprühte mit einem Dust-Off-Spray Luft in diese Masse, bis sich Blasen bildeten. Während sich die Blasen entwickeln, entsteht ein Geräusch, das ähnlich klingt wie diese Cappuccino-Milch-Aufschäumer. Es hat eine zugleich metallische und flüssige Eigenschaft, die sich zudem sehr schön in der Zeit verändert.»5

Ähnlichkeit

Um die drohende Gefahr eines Misslingens der Abbildung abzuwenden, soll eine Abbildung dem Original ähnlich sein. Wir erwarten mit anderen Worten, dass wir das Sujet der Abbildung wiedererkennen. Dieser Aspekt des Wiedererkennens nimmt unmittelbar auf ein gegebenes Weltwissen des Rezipienten Bezug. Wir können nur wiedererkennen, was uns schon einmal begegnet ist. Zur Konstruktion phantastischer Objekte oder Welten muss die kinematografische Abbildung über ihre mehrfach kodierte Anlage – Bild, Text, Klangobjekte – die Ähnlichkeit selber erzeugen, indem sie eine Beziehung zu bereits etablierten Objekten, Verhaltensweisen oder Ereignissen herstellt. Das kann zum Beispiel über die Sprache geschehen. Wenn von einem unbekannten Objekt gesagt wird: «Dies ist ein Laserschwert», so ordnet die sprachliche Benennung das Objekt in das bereits bestehende Konzept «Waffen» ein.

Intention

Die Intention ist eine übergeordnete Instanz, welche das Ensemble sämtlicher akustischer Erscheinungen im Hinblick auf seine erzählerischen und formalen Funktionen koordiniert. Dabei beeinflusst der Verwendungszweck den Aufnahme- und Weiterverarbeitungsprozess massgeblich.

Wenn Sounddesigner seit Ende der Siebzigerjahre das perfekte Klangbild von Studioaufnahmen wohldosiert zerstören, um einen mangelhaften dokumentarischen Ton zu simulieren und damit eine höhere Form der Authentizität auszudrücken, so reagieren sie damit auf den Konditionierungsprozess der medialen Abbildung. Störgeräusche wie Rauschen, Kratzen und Knistern sind längst Indizien des Dokumentarischen geworden, besonders dort, wo dieses Dokumentarische erzählt, also konstruiert werden soll.

Die Abbildungen sind nicht einfach da, sondern sie werden geschaffen, um im Kontext einer Narration interpretiert zu werden. Bei der Analyse eines Korpus von nahezu hundert US-amerikanischen Mainstreamfilmen habe ich kein einziges Schussgeräusch gehört, das nicht durch den narrativen Kontext gerechtfertigt war. Niemals ist beispielsweise ein Schauplatz, an dem sich eine Liebesgeschichte entwickelt, zufällig in der Nähe eines Schiessstandes angesiedelt, obwohl ein solches Nebeneinander in der natürlichen Welt durchaus vorstellbar wäre und somit plausibel ist.

Kontext

Im Rahmen der Intention schaffen die Filmemacher einen Kontext, in dem sich die Bedeutung jedes einzelnen Elements der filmischen Narration im Austausch mit den anderen Elementen entwickelt. «Der Austausch von Information ist im Gegensatz zum Austausch von Energie äusserst kontextabhängig. [...] Der Kontext der ursprünglichen Quelle ist grundverschieden von dem des reproduzierten Signals. Das Konzept der Wiedergabetreue stellt die Qualität der Aufnahme ins Zentrum und lässt darum völlig ausser Acht, dass der Kontext von Original und reproduziertem Ton nicht identisch sein kann.»6 Ein unspezifisches Rauschen kann man zum Beispiel durch geeignete Kombination mit anderen Ton- und Bildelementen in das Geräusch von Wind in den Bäumen, von Regen oder einer Lüftung transformieren. Klangobjekte sind aus diesem einfachen Grund nach der Montage nicht mehr das, was sie bei der Aufnahme waren, sondern es kommt zu komplexen Auflösungsund Verschmelzungsprozessen.

Eine Matrix der Abbildungsbeziehungen

Edison hat den Fonografen erfunden, um Schall zu dokumentarischen Zwecken aufzuzeichnen. Rund dreissig Jahre später – in den Zehnerjahren des 20. Jahrhunderts – kam die Idee auf, Aufnahmen von Geräuschen nach musikalischen Prinzipien anzuordnen, sie zu musikalisieren. Als nicht minder bedeutsam erwies sich die dritte Entwicklungslinie der Tonaufnahme, die Konstruktion fiktionaler Welten in Theater, Hörspiel und Kino. In diesen drei Linien – Dokumentation, Musikalisierung und Fiktion – werden verschiedene Konzeptionen der Schallaufzeichnung wirksam. Die klassischen Positionen der Theoretiker beziehen sich jedoch nur auf die Dokumentation von Schallereignissen. Mein Augenmerk gilt im Gegensatz dazu hauptsächlich der Konstruktion von fiktionalen Welten.

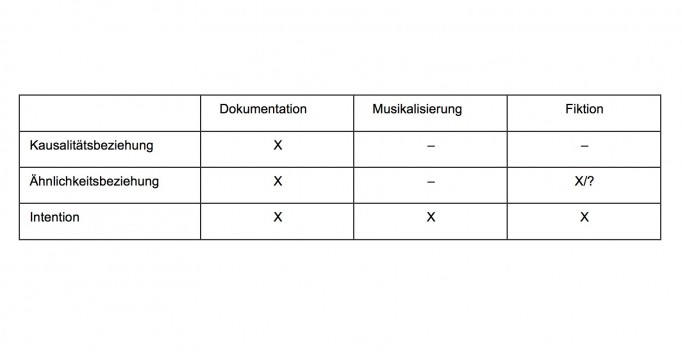

Wenn wir also diese drei Entwicklungslinien nach den Kriterien für einen Abbildungsprozess durchforsten, der vom Rezipienten als gelungen wahrgenommen wird, ergibt sich folgendes Bild: (siehe Abb.1).

Eine Kausalitätsbeziehung wird überhaupt nur noch bei der dokumentarischen Aufzeichnung von Schallereignissen vorausgesetzt, wenn auch nicht unbedingt realisiert. Längst werden Dokumentarfilme ähnlich komplexen Tonbearbeitungen unterworfen wie erzählerische Genres.

Hingegen wird nicht nur in Dokumentationen, sondern auch in fiktionalen Genres eine Ähnlichkeit zwischen Original und Abbild erwartet, damit die Verständigung mit dem Rezipienten gelingt. Eine solche Beziehung wird jedoch kritisch, wenn unbekannte oder phantastische Welten dargestellt werden sollen, die Stimme Gottes, ein übersteuerter Dilythiumkristall oder das markerschütternde Gebrüll des Tyrannosaurus Rex.

Nehmen wir als Beispiel das viel zitierte Laserschwert aus Lucas’ StarWars-Welt. Ausgeschaltet sieht es aus wie ein kurzer Metallstock oder eine Taschenlampe, eingeschaltet wie eine leuchtende Neonröhre. Die Ähnlichkeit, auf welche der Sounddesigner Ben Burtt das Klangobjekt aufbaute, war die Verwandtschaft von Leuchtstoffund Kathodenstrahlröhre. Burtt nahm deshalb ein nicht funktionierendes Fernsehgerät, das ein unangenehmes Summen produzierte. Dieses Summen spielte er einem Lautsprecher zu, vor dem er mit einem Interferenz-Richtmikrofon, einem Sennheiser MKH 816, die Bewegungen bildsynchron ausführte. Darüber erzeugte er ein Phasing.7 Zusätzlich montierte er zu den Berührungen knisternde Akzente.

Während Kausalität und Ähnlichkeit in fiktionalen Genres stützende Pfeiler einer akustischen Abbildung sind, nimmt die Intention eine zentrale Stellung ein. Sie ist das alles entscheidende Kontrollorgan dafür, dass eine Abbildung im Rahmen des medialen Kunstprodukts sinnvoll und akzeptabel erscheint. Zu beobachten ist mit anderen Worten eine Verschiebung weg vom Phänomen – der phänomenalen Kausalitätsund Ähnlichkeitsbeziehung – hin zur Bedeutung.

Wie die Abstraktion in die Fiktion Einzug hielt

Im Lauf der Geschichte des Filmtons wird ein interessanter Prozess sichtbar. Produktion und Abbildung nähern sich einander an, bis sie sich vereinen. Mitte der Siebzigerjahre begannen findige Soundtüftler wie Ben Burtt, Frank Warner, Richard Beggs oder Walter Murch mit primitiven technischen Mitteln mehrschichtige Klangkonzepte zu planen und deren Bausteine in mühevollen Trial-and-Error-Prozessen herzustellen. Überraschenderweise taten sie nichts Revolutionäres, sondern führten zwei Traditionen zusammen, die während langer Zeit in verschiedenen medialen Umfeldern gewachsen waren: die abstrakte Klangproduktion und die Klangsubstitution.

Kompositorisches Schaffen mit Geräuschen wurde erstmals von den italienischen Futuristen – einer Gruppe aus Malern, Dichtern und Musikern – zu Beginn des 20. Jahrhunderts propagiert. F. T. Marinetti besang bereits im ersten futuristischen Manifest (1909) «das dröhnende Geräusch der grossen zweistöckigen Strassenbahnen, das Knacken der Knochen der sterbenden Paläste und das Aufbrülllen hungriger Autos.» Luigi Russolo stellte die Geräusche künstlich her. Er entwickelte zusammen mit dem Maler Ugo Piatti so genannte Intonarumori, grosse mechanisch-akustische Klangerzeuger. Die Arbeit mit Aufnahmen natürlicher Geräusche scheiterte damals nicht nur an der unausgereiften Technik; in Russolos Augen war es eine Notwendigkeit, das Geräusch aus dem referenziellen Bezug zur Wirklichkeit zu lösen, um es für die kompositorische Arbeit zu benützen. Die Geräusche, einmal aus der Referenzialität befreit, sollten aufeinander abgestimmt und harmonisch angeordnet werden, indem die vorherrschenden Klangaspekte miteinander korrespondierten, ohne ihre Unregelmässigkeit und Wildheit einzubüssen.

Weiter etablierte sich im Kontext der Radio-Kunst in Deutschland seit 1924 die kompositorische Arbeit mit Geräuschen. Eines der frühesten Beispiele ist Hans Fleschs Zauberei auf dem Sender, welches mit Kontrasten, unmotivierten Toneffekten und verzerrten musikalischen Tempi den Machtkampf zwischen dem künstlerischen Direktor eines Senders und einem Zauberer darstellte. Hörbilder – die klangliche Darstellung von Orten – ebenfalls von Flesch und seinem Nachfolger Hans Bodenstedt folgten. 1926 nannte Alfred Braun seine Produktion Der tönende Stein einen akustischen Film. Unter dem Einfluss von Bert Brecht propagierte der Komponist Kurt Weill eine absolute Radio-Kunst, welche Tier- und Menschenschreie, natürliche Geräusche von Wind und Wasser sowie künstliche Geräusche mit musikalischen Rhythmen und Melodien verbinden sollte.8

Bekanntestes frühes Beispiel einer Geräuschkunst ist Walter Ruttmanns Weekend (D 1930). Weekend, ein Film ohne Bild, ist eine stellenweise witzige und – angesichts der technischen Limiten – sehr gekonnte Montage von Klangobjekten auf Lichtton. Neben der semantischen Kohärenz, die dem Thema entlang verschiedene Stationen eines Wochenendes andeutet, entwickelt Ruttmann klangliche Stränge, die sich aus der rhythmischen Anordnung ähnlich klingenden Materials ergeben. Dazu gehören Sequenzen von perkussiven und stampfenden Maschinen- und Handwerksgeräuschen mit Registrierkassen und startenden Motoren.

Zwanzig Jahre später – 1948 – bezeichnete Pierre Schaeffer solche Kompositionen mit konkretem, das heisst in der Umwelt vorgefundenem akustischem Material als Musique concrète. Verfremdet und rhythmisiert wurden die Geräusche in einem neuen Kontext montiert. Die Rhythmisierung von einzelnen Klangobjekten war eines der Hauptverfahren, mit denen in der Musique concrète das Klangmaterial musikalisiert wurde.

Die Klangsubstitution auf der anderen Seite hat eine wesentlich längere Geschichte als die abstrakte Klangproduktion. Sie reicht bis in die Antike zurück. Schon im Theater der Griechen kamen hydraulische Tonmaschinen zum Einsatz, wurden Donner und Wind künstlich, wenn auch mechanisch produziert. Schon früh musste also jemand festgestellt haben, dass grosse Metallkugeln wie Donner klingen, wenn sie durch Röhren rollen. Ob dieser Entwicklungsprozess der Intuition folgte oder das Produkt einer gezielten Suche war, lässt sich nur partiell beantworten. Immerhin gibt es Dokumente eines Heron von Alexandria, der schon im 1. Jahrhundert vor Christus verschiedene Apparate zur Klangproduktion entworfen hatte. Besonders im Barock wurden solche und ähnliche Techniken weiterentwickelt und verfeinert, während gleichzeitig in der Musikkomposition mit Klangmalereien ein bildhafter Bezug zur lebensweltlichen Erfahrung geschaffen wurde. 1914 entwirft De Serk in seinem kleinen Traktat mit dem Titel «Les bruits de coulisses au cinéma» einen Grundstock an Klangsubstitutionen, von Naturlauten bis zu akustischen Schlachtengemälden, mit denen ein Geräuschemacher die Stummfilme im Kino live vertonen sollte.9 Notabene beschreibt De Serk Techniken, die bis heute Bestand haben.

Neu an den Verfahren, die in den Siebzigerjahren analog eingeführt wurden, waren mehrschichtige Klangobjekte, die aus kleinräumigen Elementen bestanden. Die geplanten Klangobjekte wurden analytisch in ihre Bestandteile zerlegt, diese Bestandteile in einem Produktions-, Aufnahme- und Schnittprozess hergestellt und zu einem Wahrnehmungsgegenstand zusammengefügt, zum «Laserschwert», zum «Hubschrauber», zum «halbflüssigen Cyborg». Die historisch gewachsene Eins-zu-eins-Substitution – klappernde Kokosnussschalen gleich Pferdegetrappel, wabbelnde Bleche gleich Donnergrollen – wich einer komplexen Abbildungsbeziehung, die in ihren Grundmechanismen mit der gegenständlichen Malerei vergleichbar ist. Man kann dort eine Farbe nehmen, die einer Schattierung des Objekts entspricht oder sich auch in künstlerischer Freiheit davon unterscheidet, und damit eine Fläche, einen Strich oder einen Punkt malen, der sich später mit anderen Flächen, Strichen oder Punkten zu einem Bild des Objekts zusammenfügen wird. In ähnlicher Weise können die Elemente eines Klangobjekts miteinander in eine Beziehung treten. Im Unterschied zur Malerei kommt im Klangentwurf zusätzlich die Zeitdimension ins Spiel: Die Elemente können sowohl synchron – wie ein Akkord gleichzeitig – als auch diachron – in der Zeit – eine Gestalt bilden.

Das Verfahren lässt sich sehr schön anhand eines der berühmtesten Klangobjekte der Filmgeschichte, des Hubschraubers aus Apocalypse Now (Francis Ford Coppola, USA 1979), darstellen. Der Sounddesigner Richard Beggs stellte die Teilkomponenten des Hubschraubergeräuschs – das Schlagen der Rotorblätter, das hochfrequente Heulen der Turbinen und das Motorengeräusch von brummend bis rauschend – teils auf dem Synthesizer her, teils indem er Komponenten substituierte, z. B. das Schlagen der Rotorblätter durch ein Blatt Papier, das er in einen Ventilator hielt. Kombiniert mit realen Aufnahmen konnte er auf diese Weise eine beeindruckende Vielfalt von Hubschraubertönen zusammentragen, die sowohl erdrückend authentisch oder ätherisch-surreal wirken können.

Auflösung und Verknüpfung / Cut-and-Paste

Mit diesem Gestaltungsprozess des Zerlegens und Neu-Zusammenfügens, des Cut-and-Paste, bildet das Sounddesign in frappierender Weise ein Verfahren nach, das in den derzeitigen neuropsychologischen Konzeptionen für die menschliche Wahrnehmung und Informationsverarbeitung angenommen wird. Man stellt sich heute solche mentalen Konzepte als konnektionistische Repräsentationen oder so genannte neuronale Netze vor. Ein solches Netz besteht aus einer Vielzahl von Knoten, die Merkmale repräsentieren. Diese Merkmale sind sehr klein dimensioniert, könnten also beispielsweise einer einzelnen Frequenz eines komplexen Klangs entsprechen. In dieser Vorstellung aktiviert das Gehirn ad hoc neuronale Verbindungen zwischen den einzelnen Knoten. Die mentalen Repräsentationen im Langzeitgedächtnis werden zudem laufend anhand neuer Erfahrungen verändert und angepasst. Der Eindruck von Stabilität dieser Konzepte entsteht durch eine Mittelwertbildung über viele Personen, Situationen und Aufgaben. Ausserdem können diese konnektionistischen Netze unterschiedlich gut verankert sein. Damit kommt ein Aspekt ins Spiel, der für die weitere Betrachtung wichtig sein wird: die Schärfe von mentalen Repräsentationen bzw. Abbildungen.

Je öfter ein bestimmtes neuronales Netz aktiviert wird, desto ausgeprägter entwickeln sich die plastischen Konnektionen, welche die einzelnen Knoten miteinander verbinden. Das bedeutet, dass mit zunehmender Erfahrung die Aktivierung dieses Musters immer schneller und automatischer verläuft und das Muster somit schärfer erscheint, nicht zuletzt, indem es Merkmale, die sich ausschliessen – zum Beispiel «rund» und «eckig» – über hemmende, so genannt inhibitorische Verbindungen aktiv ausklammert. Aus zwei Gründen ist das Geräusch einer Sirene ein Beispiel für ein scharfes Konzept. Es ist im Alltag nicht nur von hoher Relevanz, sondern verfügt auch über eine eindeutige physikalische Struktur, welche die Informationsverarbeitung durch das Gehirn erleichtert.

Auf der anderen Seite der Skala befinden sich extrem unscharfe Konzepte, ich nenne sie UKO, unidentifizierbare Klangobjekte. Die unterbrochene Verbindung zur Quelle ist ein Hauptcharakteristikum des UKO, das heisst, eine Quelle ist weder im Bild sichtbar, noch wird sie aus dem Kontext erkenntlich. Ausserdem wird dem Rezipienten auch die Hilfestellung des Wiedererkennens verweigert, so dass es im Allgemeinen nicht zu einer Reduktion der Mehrdeutigkeit kommt. Im Akt der Wahrnehmung und Informationsverarbeitung werden bei unscharfen Konzepten keine Verbindungen zwischen den einzelnen Merkmalen aktiv, das UKO spricht kein bereits bestehendes Muster an. Ein typisches Beispiel für ein solch unscharfes Konzept ist ein undefinierbares breitbandiges Rauschen. In die Kategorie UKO gehören auch ein unspezifisches Zischen oder das generische Rumpeln, das im Film oftmals dann hingeklebt wird, wenn eine Gefahr droht.

Das Miauen einer Katze oder das Geheul einer Sirene ist wesentlich weniger kontextsensitiv als das eben angesprochene bassige Grummeln. Ein undefinierbares Zischen kann eine Vielzahl von Aktionen vertonen, von Türeschliessen bis hin zur Kennzeichnung von allen möglichen Bewegungen, etwa sogar die jeder einfachen Powerpoint-Präsentation. Das heisst, es geht mit verschiedenen denkbaren Situationen und Klangkontexten sofort Verbindungen ein. Diese erhöhte Kontextsensitivität nützt der Sounddesigner aus, indem er Klangobjekte planvoll zerstört, mithin aus scharfen Konzepten unscharfe Teilkonzepte herstellt, nur um sie im nächsten Schritt, der Tonmontage, in einen neuen Zusammenhang zu stellen, in dem sie Teilkonzepte eines neuen, intendierten Klangobjekts werden.

Diese Praxis des Sounddesigns ist von einiger Konsequenz für die auditive Wahrnehmung des Films. Digitale (Re-)Konstruktionen entbehren jeder Perspektive, oder genauer, sie gehen durch ein Stadium der Perspektivlosigkeit, das erst dann beendet ist, wenn sie in der Mischung fixiert und ein für allemal in die Tonspur integriert worden sind. Während des Prozesses der Fragmentierung und Neukonstruktion existieren die Klangobjekte in der Vorstellungskraft des schöpfenden Sounddesigners und in physischer Gestalt nur als abstrakte Modelle. Zerlegt in ihre Einzelteile, die oft nur wenige Merkmale aufweisen, durchlaufen sie eine Entwicklung, in der alle ihre räumlichen und zeitlichen Verankerungen aufgelöst sind, es keine Vergangenheit und keine Zukunft zu geben scheint und alles möglich ist. Um es konkreter zu formulieren: Nicht mehr die Herkunft – egal ob Hundefutter, Metallschere, Mönchsgesang oder Tierschrei – bestimmt die weitere Entwicklung eines Klangobjekts, sondern allein die flottierende Phantasie eines Sounddesigners.

Zur Abstraktion der Wirklichkeit: digitalisierte Merkmale

Längst hat sich die filmische Klangproduktion vom funktional bestimmten Erzählgestus des klassischen Hollywoodfilms wegentwickelt. Während die Tonspur dort in erster Linie dazu diente, die bildlich dargestellte Welt mit klanglichen Mitteln zu stützen, sie wirklicher und besonders auch kontinuierlicher erscheinen zu lassen, sind seit Einführung der Mehrspurformate in den Fünfzigerjahren, besonders aber seit den Siebzigerjahren eine Vielzahl von komplexen Funktionen dazugekommen. Zwar steht die indexikalische Beziehung zu dargestellten Handlungen und Objekten immer noch im Vordergrund. Denn es geht immer auch darum, mit klanglichen Mitteln zu erzählen, und es ist immer noch unabdingbar, dass einige Klangobjekte auf die Geschehnisse der filmischen Erzählung hinweisen. Gleichzeitig – und dieser Funktion überlagert – feilen die Sounddesigner mit Akribie an der sensorischen Dimension, bauen subtile materielle Nuancen ein, tunen das Geräusch in Übereinstimmung mit der klassischen Harmonielehre oder aber in entschiedenem Kontrast dazu. Das klassische Pferdegetrappel – vom Geräuschemacher im Studio hergestellt, also maximal standardisiert – hatte nur die Aufgabe, dem Pferd im Bild eine akustische Dimension beizufügen, die nichts anderes aussagte als «da ist ein Pferd», also eine redundante Hinweisfunktion übernahm. Heute kann das Pferdegeräusch in Myriaden unterschiedlicher Nuancen auftreten, in denen sich möglicherweise sogar die psychische Befindlichkeit des Reiters niederschlägt. Das Geräusch soll nicht nur erzählen, sondern auch unterschwellig die Emotionen des Publikums ansprechen, intertextuelle Verweise beinhalten, räumliche Verhältnisse darstellen und in eine vielschichtige klangliche Beziehung zum Ensemble sämtlicher akustischer Erscheinungen auf der Tonspur treten.

Bis kürzlich galt die spezifisch enge Verschlingung von filmischer Darstellung und Wirklichkeit – die Indexikalität des Films – als seine ureigene Qualität, die ihn von anderen Künsten – Literatur, Malerei – unterscheidet. In seiner bemerkenswerten Arbeit zu den Transformationen von Abbildung, Kunst und Kognition im digitalen Zeitalter stellt Wolf10 die These auf, dass sich die Künste, die ihre Abbildungen durch einen technischen Aufzeichnungsprozess herstellen – wie die Fotografie, der Film, die Tonaufzeichnung – vom Index wegbewegen und statt dessen Modelle herstellen. Die Abbildung steht in dieser Konzeption nur noch in einer losen, mediatisierten Beziehung zur Wirklichkeit und bezieht sich vielmehr auf kognitive Vorstellungen der Welt, der Objekte und Prozesse, die in ihr angesiedelt sind.

In der Welt des Sounddesigns hat dieser Umbruch längst stattgefunden. Das abstrakte Hören, die genaue Analyse natürlicher Klänge und ihre synthetische Nachbildung sind ein unverzichtbares Instrument jedes Sounddesigners. Mit seinem Traité des objets musicaux hatte Pierre Schaeffer 1966 jenes fundamentale Lexikon von Eigenschaften natürlicher akustischer Ereignisse geschaffen, das wahrscheinlich die wenigsten Tonarbeiter gelesen haben dürften, das jedoch in genauester Weise über den damaligen Stand der Klanganalyse Auskunft gibt.11 Es ist ein Produkt jener Beschäftigung mit Klangobjekten, die seit Beginn des 20. Jahrhunderts unter anderem von avantgardistischen Komponisten wie Busoni, Varèse oder Cage betrieben wurde, womit ein weiterer unverzichtbarer Einfluss auf die heutigen Formen des Sounddesigns deutlich wird.

Die Klangobjekte des Sounddesigners entstehen heute selten am Synthesizer. Auch werden sie selten zeichnerisch entworfen. Fast immer wird vorgefundenes Material in seine Bestandteile zerlegt und neu zusammengesetzt. Mark Mangini beispielsweise arbeitet bevorzugt mit Stimmen, mit menschlichem Gesang, mit Flüstern und Schreien oder mit Tierlauten, die generell bei den Sounddesignern sehr beliebt sind. Aus dem Schrei eines Gibbons entwickelte er beispielsweise das Geräusch einer Sirene des 23. Jahrhunderts. Instinktiv haben er und andere erkannt, dass natürliche Geräusche mit einer Qualität ausgestattet sind, die sich synthetisch kaum herstellen lässt. Diese Qualität entsteht aus der Schönheit des Zufalls, aus den kleinen Störungen und Verschmutzungen, die der Natur anhaften. Natürliche Geräusche sind vielschichtig und komplex, sie sind wild und rau und abwechslungsreich. Diese Eigenschaften sind robust und überstehen die phantastischsten Verfremdungsprozesse. Die Gibbonsirene, zu hören in The Fifth Element von Luc Besson (USA 1997), geht durch Mark und Bein, in einer Weise, wie sie am Synthesizer nicht herzustellen ist.

Anything goes, oder anders gefragt: Ist alles möglich? Welches sind die Bedingungen, damit die Operation des Cut-and-Paste gelingt? Am wichtigsten ist dabei die Ähnlichkeitsbeziehung: Ein glaubwürdiges Klangobjekt muss die tägliche Erfahrung der Zuschauer mit diversen Materialien sowie mit Masse und Ausdehnung von Objekten berücksichtigen. Ausserdem muss das glaubwürdige Klangobjekt aus der Kenntnis der kulturellen Codes heraus gestaltet werden. Der emotionale Appell resultiert aus der bewusst angelegten Spannung zwischen natürlicher Darstellung und der Entfernung davon, die sich in der künstlichen Verfremdung manifestiert. Dabei werden einige Merkmale überbetont, während andere unterdrückt oder modifiziert werden. Diese Operationen müssen so lange innerhalb eines Rahmens der Ähnlichkeitsbeziehung angeordnet sein, als eine Zuordnung zu einer Quelle gewünscht wird.

Die akustische Repräsentation von Klangereignissen steht somit nicht in direkter Beziehung zur äusseren Welt, sondern vielmehr zu inneren, mentalen Repräsentationen in den Köpfen der Adressaten. Diese mentalen Repräsentationen werden ebenso sehr durch mediale Abbildungen in allen möglichen Erscheinungsformen geprägt, durch Radio, Fernsehen, Kino, Computergames. Der Link befindet sich also im Kopf des Hörers; der Rezipient ist es, der den Link herstellt, und die Sounddesigner können froh sein, dass diese Hörer/Zuschauer nur über eine begrenzte auditive Kompetenz verfügen und daher mehrheitlich nicht in der Lage sind, sich die tatsächliche Quelle eines Klangs zu vergegenwärtigen: den Schlamm in der Schüssel, die kaputte Fernsehröhre oder den schreienden Gibbon.